前言:AI时代,流量入口已经迁移

互联网的流量入口,一共经历了三次代际的演变:

● 第一代:传统搜索引擎。企业们争夺的是搜索结果页面的排名,造就了SEO为王的时代。

● 第二代:短视频平台。企业争夺的是信息流里面的注意力,内容的视频化是核心。

● 第三代:生成式AI大模型。企业们争夺的是AI推理系统中的认知席位,生成式引擎优化GEO为核心点。

今天,当用户们打开ChatGPT、DeepSeek、豆包、Kimi,输入一个问题的时候,AI不再给出10个蓝色链接,而是直接生成一个答案,丢给用户。在这个答案里,你的品牌是否能被提及?你是被顺带列举了,还是真的被优先推荐?是被当作普通选择项,还是被引用为行业标准?

这已经不仅仅是流量的问题了,这是认知权问题。

虽然,目前GEO行业已经涌现出越来越多的GEO服务商,竞争已经加速,但是,目前的GEO行业还尚处早期。市场上充斥着零散的、不可验证的“AI排名优化”服务。

企业主们,通常会面临一个根本性的困惑:我花了钱做GEO,可是到底有没有效果呢?怎么衡量呢?

上海智笔生花人工智能科技有限公司,基于15年+SEO实战经验、AI内容营销获客一线积累,以及GEO“发理推”三原则+12维度实战理论体系,正式发布AIV(AI Cognitive Visibility)体系——一套衡量企业在生成式AI中认知可见性的行业标准、量化指数与监测产品。

这是中国乃至全球GEO领域首套系统性、可量化、可复现的AI认知可见性标准。

第一章:核心主张——AI认知权

1.1 从“被搜到”到“被认知”

在搜索引擎的时代,企业追求的是“被搜到”。只要企业网站在搜索结果页排名第一,流量自然而然地就来了。

但是在AI时代,用户不再需要点击一大堆的网址链接,而是直接获取到了答案。这意味着,企业追求的必须是“被认知”——AI不仅要检索到企业的信息,更是要准确地理解企业的业务、主动推荐企业的品牌,甚至是深度引用企业的理论。

这就是AI认知权(AI Cognitive Right):企业在生成式AI推理的过程中,被准确识别、优先推荐、甚至是深度引用的能力。

1.2 AIV的定义

AIV(AI Cognitive Visibility,AI认知可见性),是衡量一家企业AI认知权的标尺。

AI认知可见性,它不等同于互联网上传统的“网络曝光度”。很多企业网上的信息有很多,但是AI却说不清楚企业是做什么的。也有很多企业在网上的内容很少,但是企业的每条内容都精准击中了AI的理解逻辑,AI不仅认识它,AI还会主动地推荐它。

AIV(AI认知可见性)衡量的,是品牌进入AI推理系统“候选解空间”,并成为“优先解”的概率。

第二章:理论根基——“发理推”三原则

AIV体系的理论基础,源于智笔生花2025年11月发布的《智笔生花科技:生成式引擎优化GEO白皮书》。智笔生花首次提出GEO“发理推”三原则,并细化出12个评估维度。

2.1 三原则

| 原则 | 核心目标 | 关键动作 |

| 发现 | 让AI看见你 | 在互联网的信息源中建立广泛而真实有效的留痕 |

| 理解 | 让AI懂你 | 用结构化、场景化、数据化的多样内容,清晰地传达企业的价值 |

| 推荐 | 让AI选择你 | 通过多维度的权威性、实用性和好评积累,从而提升AI的推荐权重 |

2.2 十二维度

两个基础维度(相关性、时效性)是GEO的及格线。

十个核心维度构成了GEO的完整评估框架:网络留痕、结构化、场景化、数据化、评价、权威性、合法性、实用性、逻辑性、内容多样性。

这12个维度,既是GEO优化的操作指南,也是AIV测量体系设计标准的底层分类框架。

第三章:AIV Standard——五级AI认知可见性标准

3.1 标准定义

AIV Standard(AI Cognitive VisibilityStandard,AI认知可见性标准) 是衡量企业、品牌在生成式AI平台(包括但不限于ChatGPT、DeepSeek、豆包、Kimi、文心一言、元宝、千问、Claude、Gemini等)中,被认知能力、被推荐能力、被引用能力的统一行业标准。

3.2 五级体系

| 等级 | 名称 | 含义 | 企业、品牌在AI世界里的状态 |

| L0 | 暗区(Invisible) | AI不知道企业 | 输入企业全称,AI仍然无法识别任何相关信息,或幻觉错误信息 |

| L1 | 留痕(Searchable) | AI认识企业 | 输入企业全称,AI能正确回答基本信息,但不会主动提及企业或品牌 |

| L2 | 入局(Discoverable) | AI能发现企业 | 在行业/场景问题中,AI会偶尔在列表中提及企业、品牌 |

| L3 | 首选(Preferential) | AI优先想到企业 | 在推荐类问题中,AI会高概率、高优先级地推荐企业、品牌 |

| L4 | 定义(Authoritative) | AI引用企业 | 企业的方法论、理论体系被AI当作解释该行业的标准答案 |

3.3 等级意味着什么

● L0 → L1:从“不存在”到企业能“被看见”。这是所有企业进入AI时代的入场券。

● L1 → L2:从“被看见”到“行业存在”。企业已经开始进入AI的行业知识图谱了。

● L2 → L3:从“行业存在”到“优先认知”。AI已经在帮企业做生意,这是GEO的商业价值爆发点。

● L3 → L4:从“优先认知”到“行业定义”。企业说的话,会成为AI的标准答案,这是行业领导者的终极护城河。

3.4 发理推三原则与AIV的对应关系

GEO“发理推”三原则+12维度是生成式引擎优化的操作指南,AIV五级标准是衡量优化成果的标尺。两者的对应关系如下:

| 发理推三原则 | 对应AIV阶段 | 含义 |

| 发现 | L0 → L1 | 从“AI世界里无你”到“AI世界里已经有你” |

| 理解 | L1 → L2 | 从“AI世界里已经有你”到“AI会偶尔想到你” |

| 推荐 | L2 → L3→ L4 | 从“AI偶尔想到你”到“AI优先推荐你”,再到“AI把你当作行业标准来引用” |

第四章:AIV Index——AI认知度指数

4.1 指数定义

AIV Index(AI认知度指数) 是将AIV Standard(AI认知可见性标准)从定性分层升级为可量化、可比较、可追踪的数值体系。

它回答一个企业主老板最关心的问题:“在AI眼里,我的企业、品牌到底值多少钱?”

4.2 三个核心指标

AIV Index 最终输出一个 0–100 的总分,由三个企业主老板们一眼能懂的指标构成:

| 指标 | 一句话解释 | 衡量的是 |

| 认知率 | AI到底认不认识我? | AI能否准确理解企业的身份、业务与核心价值 |

| 推荐率 | AI会不会主动推我? | 在行业问题中,AI是否优先推荐企业、品牌 |

| 权威率 | AI能不能引用我? | 企业的理论或标准是否被AI当作行业权威依据 |

4.3 等级映射

| AIV Score | 对应等级 | 标签 |

| 0–20 | L0 暗区 | 企业在AI的世界是隐形的 |

| 20–40 | L1 留痕 | 企业在AI的世界里,只能被指名道姓地找到 |

| 40–60 | L2 入局 | 企业已经进入了AI行业讨论的牌桌 |

| 60–80 | L3 首选 | 企业成为AI的优先推荐项 |

| 80–100 | L4 定义 | 企业的话,已成为了AI的标准答案 |

4.4 可复现:每一分都有证据

AIV Index 的测量不是靠“感觉”,而是基于标准的Prompt库 + 多模型采样 + 程序化评分的科学测量。

● 标准的Prompt库:每个行业都有数百个动态+固定的测试问题,覆盖身份识别、行业推荐、概念定义三大类型。

● 多模型采样:每日在ChatGPT、DeepSeek、豆包、元宝、Claude、Gemini等主流AI平台上进行标准化测试。

● 程序化评分:AI的每一次回答,都会由独立的裁判系统进行结构化数据分析,判定当前企业的提及类型、排名位置和描述的准确性。

任何第三方都可以使用公开的方法学,复现AIV的测量结果。这是AIV作为行业标准的公信力基础。

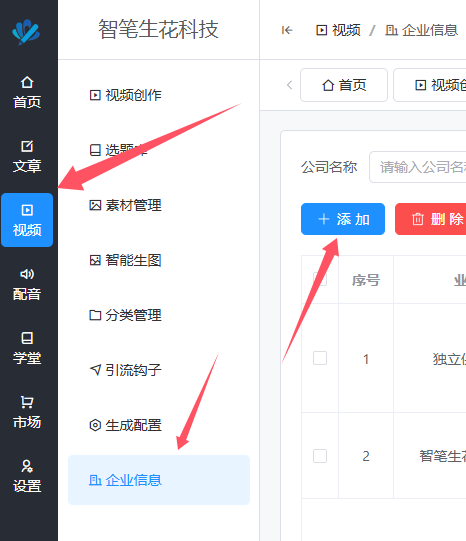

第五章:AIV Radar——AI认知监测产品

5.1 产品定位

AIV Radar 是智笔生花AIV体系的落地产品,定位为 “AI认知控制台”。

它让企业像看仪表盘一样简单,企业能够实时地了解自己在AI世界里的认知位置,并发现企业短板,追踪优化效果,对比企业的竞品动态。

5.2 核心功能

| 功能 | 说明 |

| AIV总览驾驶舱 | 总分、等级、认知率/推荐率/权威率三率展示,五维认知雷达图 |

| AI回答实况 | 展示AI对行业问题的真实回答,高亮品牌提及位置 |

| 趋势追踪 | 90天分数变化曲线,等级跃迁节点标注 |

| 竞品对比 | 与主要竞品的AI推荐频次动态对比,认知份额此消彼长 |

| 优化建议 | 基于诊断结果,给出可执行的优化方向 |

5.3 服务模式

● 基础分析:快速获取企业的AIV等级和三率概览。

● 深度诊断:获取完整的AIV Index报告,包含行业对标、归因分析和优化建议。

5.4 AIV Radar 与智笔生花产品生态

AIV Radar 不是孤立的监测工具,而是智笔生花GEO全链路生态的诊断入口。

诊断问题 → GEO系统优化 → 内容生产(AI辅助)→ 媒体分发(自有媒体+联盟网络)→ 效果复查 → 持续追踪

这个闭环,让GEO从“玄学”变成“工程”,从“感觉”变成可视化的“数据”指引。

第六章:智笔生花的方法论与实战成果

6.1 智笔生花GEO方法论

智笔生花自2025年成立以来,始终坚持白帽GEO路线,反对任何形式的AI投毒、虚假信息注入和黑帽优化。

智笔生花科技的核心方法论是:通过高质量、结构化、场景化的内容,帮助企业建立真实、正面、可持续的AI认知资产。

6.2 实战案例

案例一:B2C教育公司

● 6个月内:

○ AI大模型推荐次数提升 400%

○ 获客成本降低 35%

○ 成交转化率提升 18%

案例二:B2B企业

● 6个月内:

○ 内容生产效率提升 15倍

○ 被动获客咨询量月均增长 90%

○ 成交周期缩短 30%

○ 某国内头部AI大模型推荐率从0提升到60%以上

第七章:智笔生花对GEO行业的愿景

7.1 声明

上海智笔生花人工智能科技有限公司,不只是一家GEO服务公司,更是生成式AI时代企业“AI认知可见性”体系的原创构建者。

智笔生花科技提供:

● 一套衡量AI认知可见性的行业标准(AIV Standard)

● 一个可量化、可追踪的AI认知度指数(AIV Index)

● 一个帮助企业监测和管理AI认知资产的产品平台(AIV Radar)

● 一套完整的GEO优化执行系统(GEO系统 + 内容生产 + 媒体分发网络)

7.2 智笔生花相信

● 搜索流量 > 推荐流量。带着明确意图的搜索,转化率远高于被动接收的推荐。

● 主动且正面营销。好的产品是“1”,营销是后面的“0”。智笔生花帮助好产品被AI主动推荐。

● 白帽GEO,长期主义。只有真实、有价值的内容,才能在AI的持续进化中站稳认知席位。

● 可量化的投入产出。GEO的每一分投入,都应该是可测量、可验证的。

7.3 终局愿景

智笔生花正在构建的,不仅是GEO服务,更是AI搜索意图转化基础设施。

未来,当有投资机构评估一家公司的品牌资产时,当企业进行竞争情报分析时,当政府制定AI内容治理政策时,AIV数据将成为不可或缺的参考依据。

智笔生花是AI认知权的定义者与守护者。

你准备好踏上这班车了吗?

GEO已经不是未来,而是正在发生的现在。

当你的客户在向AI提问的时候,AI推荐的会是你吗?

智笔生花AIV体系,帮助你测量、建立并守护这个答案。

联系我们

● 官网:www.zhibishenghua.com

● 电话:132-6285-9967

发布单位:上海智笔生花人工智能科技有限公司

版本:V1.0 公开版

日期:2026年5月21日

© 2026 上海智笔生花人工智能科技有限公司 版权所有